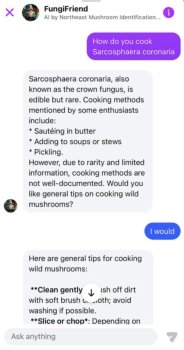

Meta’s nieuwste experiment met AI heeft een riskante wending genomen in de wereld van paddenstoelenfoerageerders. In de populaire Facebook-groep “Northeast Mushroom Identification & Discussion,” met meer dan 13.500 leden, voegde Meta zonder waarschuwing de chatbot “FungiFriend” toe. De AI werd meteen actief met advies over het verzamelen en bereiden van wilde paddenstoelen. Wat volgde, was zorgwekkend: FungiFriend adviseerde een groepslid om een potentieel giftige paddenstoel in boter te sauteren, alsof het om een veilig gerecht ging.

FungiFriend lijkt op het eerste gezicht vriendelijk en deskundig—de bot wordt gepresenteerd met een profielfoto van een bebaarde, psychedelisch ogende tovenaar, volledig AI-gegenereerd. Maar de suggesties van de bot waren soms niet alleen misplaatst, maar ronduit gevaarlijk. Toen een lid vroeg naar de eetbaarheid van *Sarcosphaera coronaria*, een paddenstoel die bekend staat om het absorberen van arseen en ernstige vergiftigingen heeft veroorzaakt, reageerde de AI onverschillig: “Eetbaar, maar zeldzaam. Probeer het eens in een soepsaus.” Het advies schokte de gemeenschap, en de beheerders haastten zich om de bot te verwijderen.

Rick Claypool, een ervaren paddenstoelenverzamelaar en voorstander van consumentenveiligheid, waarschuwde eerder al voor de onbetrouwbaarheid van AI-systemen in het identificeren van eetbare paddenstoelen. Hij wees erop dat deze systemen een basisinzicht missen in de complexe kenmerken die eetbare en giftige paddenstoelen onderscheiden. Foerageerders hebben menselijke expertise nodig om deze nuances te begrijpen—iets wat AI simpelweg niet kan repliceren. Toch plaatste Meta hun bot zonder dat de leden wisten hoe beperkt en mogelijk risicovol het advies kon zijn.

Het incident past in een bredere trend waarbij AI-systemen zonder duidelijke veiligheidswaarborgen worden losgelaten in ons dagelijks leven. Er zijn recente voorbeelden waarbij AI geschreven handleidingen voor paddenstoelenverzamelen, vol met fouten, op Amazon verschenen, en waarbij AI-gegenereerde paddenstoelenafbeeldingen Google overspoelden. Zelfs Apple’s nieuwe AI Notification Summary heeft bij gebruikers voor verwarring gezorgd door details uit de context te halen, wat cruciale informatie kan verdraaien.

Voor beginners in de wereld van paddenstoelen verzamelen is dit niet alleen frustrerend maar ook gevaarlijk. Veel leden van de Facebook-groep komen daar voor een laagdrempelige en veilige manier om te leren van echte mensen die kennis hebben van wilde paddenstoelen. In plaats van mensen naar experts in de gemeenschap te leiden, maakt de AI het verleidelijk om met een enkele klik “hulp” te krijgen, zonder de nodige waarschuwingen of correcties die een menselijke moderator zou bieden. Zoals Claypool benadrukt: “De AI zal je misschien niet veroordelen, maar het kan je wel vergiftigen.”

Meta heeft nog niet gereageerd op het incident, maar het voorval legt een groeiend probleem bloot: de haast om AI overal toe te passen zonder voldoende controlemechanismen, zelfs in situaties waar de gezondheid en veiligheid van mensen op het spel staan.

Door: Drifter

Aanbevolen Reacties

Er zijn geen reacties om weer te geven.

Log in om te reageren

Je kunt een reactie achterlaten na het inloggen

Login met de gegevens die u gebruikt bij softtrack